具身智能領域最近有一個心照不宣的焦慮:真機遙操作數據這條路,可能走不下去了。

成本是一方面——采集一小時數據動輒花數百元,還得搭一套專業動捕環境。

速度更是硬傷:人盯著屏幕遙控機械臂,采集節奏很難跟上真實生產節拍。

這意味著,單純依賴遙操作數據,恐怕無力同時支撐大規模訓練與產業落地。

那換條路呢?

人類本來就在真實作業場景中完成海量高精細操作,讓人直接干活,再把人的操作數據扒下來給機器人用。

難點至少兩個。

第一,人手和機械手長得不一樣,人類操作不能直接平移到機器人身上。

第二,如果只靠第一視角視頻去還原人手動作,精度又往往不夠,很難支撐高精細任務。

靈初智能最近交了一份答卷。

他們用10萬小時人類操作數據搭了一套PSI框架,里面有兩個大模型:策略模型Psi-R2負責學「任務該怎么做」,世界模型Psi-W0負責補「換種做法會怎樣」,再把人類操作一步步轉成機器人真能執行的動作。

模型之外,靈初還亮出了近10萬小時人類數據,以及1000小時開源數據集。

這套方法之外,靈初智能同時拿出了近10萬小時人類數據,以及1000小時開源數據集。

一、10萬小時人類數據

開始被當作機器人預訓練的主料

這套路子的起點很簡單:把人類操作數據直接塞進機器人預訓練的主干。

據靈初披露,Psi-R2預訓練同時用真機數據和人類數據。

真機數據來自靈初Psi-MobiDex數據集,5417小時;人類數據總規模95472小時,覆蓋294種場景、4821種任務、1382種物體。

背后是一種很直接的判斷。

具身智能長期缺「存量數據」——不像自動駕駛有多年路測積累,也不像大模型能從互聯網白撿海量文本。

機器人想學會做事,沒法像文字或圖像那樣從現成語料里撈,只能靠現實世界一口一口喂。

真機遙操作曾經是條相對自然的路,但模型規模一大、任務一復雜,這種數據供給方式就開始掉鏈子。

于是人類數據的價值被重新抬了上來。

說白了,機器人想學會干活,最密集、最成熟的示范樣本,本來就長在人手上。

關鍵是怎么把人類數據和真機數據捏在一起訓。

靈初試過一堆更復雜的招:圖像修復、關鍵點輔助損失、跨空間對齊……小數據量時確實管用。

但數據一上量,這些精巧模塊全成了瓶頸。

原因不復雜,這些方法本質上是想讓人手和機械手看起來一樣,可它倆的物理規律壓根不同。

對手機裝配這種精細活,強行對齊反而引入誤差。

最后剩下的,反而是一條樸素的路線:Raw Data In, Raw Data Out。

落到工程上,就是把人手關節用運動學公式硬算成機械手關節,圖像原封不動直接喂給模型,人為處理越少越好。

從結果看,這條路線暫時跑通了。

據靈初披露,Psi-R2完成預訓練后,只要用少于100條軌跡的真機數據微調,就能干手機裝配、工業包裝、紙盒折疊這些長時序、高精度的活。

光有數據還不夠。

怎么讓機器人「吃」進去?這就引出這套框架的真正核心——世界模型里的強化學習。

二、Psi-W0

把「如果失敗了會怎樣」補了回來

光看Psi-R2,這套方法有個天然缺口:它擅長從成功軌跡中學習,但自己很難長出反事實能力。

這正是世界模型該上場的地方。

Psi-W0吃進圖像、語言指令和機器人動作軌跡,吐出未來場景的視頻預測。

它和Psi-R2最大的不同在于:動作在這里不只是預測結果,而是直接參與條件生成。

說白了,它就是一個動作條件型世界模型(AC-WM)。

再直白一點:Psi-R2像「會做題的學生」,Psi-W0像一套能把過程重新推演的系統。

策略模型知道什么動作曾經成功,卻不知道動作偏一點、順序亂一點、接觸晚一點會發生什么。

可偏偏強化學習、策略評估、人類動作向機器人動作的真正遷移,全都離不開這部分信息。

為了讓模型學會理解失敗,Psi-W0在訓練里額外加入了約30%的失敗樣本,這些數據來自專項采集、常規采集和推理過程。

這樣一來,它不只認識「成功長什么樣」,也開始知道「失敗會怎樣展開」。

在整套系統里,Psi-W0承擔著兩層作用。

第一層是評估。類數據規模再大,也不等于知識自動進了模型。

策略到底有沒有真學會「人怎么做這件事」?

需要一個能推演軌跡、判斷結果的系統來檢驗,Psi-W0就是這個角色。

第二層更關鍵:它直接參與把人類數據轉成機器人數據。

以抓取任務為例。人類抓蘋果的動作映射到機器人身上,很可能就差那么一丁點就抓不起來。

對高精細任務,這種偏差往往是致命的。

傳統做法得把場景和物體重建進仿真器,再在仿真里做強化學習微調——流程重、成本高,還得忍受Sim2Real gap。

靈初智能的思路,是把這過程搬進世界模型里完成。

先讓Psi-R2學一條人類數據,再把軌跡交給Psi-W0推演,在機器人視覺和機器人動力學條件下看動作結果;不理想就繼續用強化學習調,直到這條軌跡更貼近機器人真能執行的狀態。

整體看,這相當于多了一層「夢里試錯」的空間。

好軌跡可以回流到訓練中,成為新的有效數據;偏掉的軌跡也有價值,它們幫助模型識別失敗邊界,推動世界模型越來越準。

所謂數據飛輪,就是這么轉起來的。

這套方法很快在公開榜單上被驗證了。

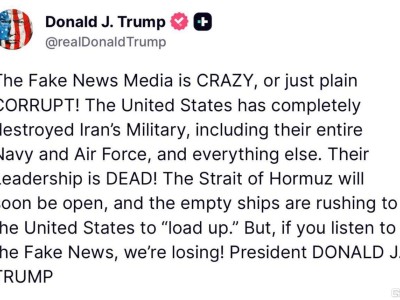

在由美國 Allen Institute for AI 發起的 MolmoSpaces 榜單中,靈初智能的 Psi-R2 在總榜中位列第一,整體表現超過具身大模型標桿 π 以及英偉達 GEAR 等主流方案,并與其他基線模型拉開差距。

MolmoSpaces 是當前具身智能領域少數與真實世界評測具有較強相關性的公開基準之一。NVIDIA、PI 等全球頂尖團隊均參與本次評測。而 Psi-R2 位列其上。

三、數據真正的分水嶺

在于信噪比、精度和節拍

如果說雙模型架構回答的是「怎么學」,那這次發布里另一個更耐人尋味的問題,是「什么樣的數據才值得學」。

靈初智能給出了一個很干脆的判斷。

決定數據價值的核心因素,不在數量本身,而在信噪比。

低信噪比數據不光效率低,還會拖垮訓練效果。

再往細了拆:在數據分布上,優先級是任務多樣性 > 物體多樣性 >> 場景多樣性;在感知模態上,優先級是精準3D位姿 >> 觸覺模態 > 2D圖像特征。

這組結論挺有指向性。

它說明具身智能模型真正缺的,是更豐富的任務類型、更扎實的物體交互、更高精度的動作軌跡。

畢竟對操作任務來說,背景很多時候只是背景,模型真正要學的是物體、動作和接觸關系。

在這幾個維度里,3D位姿精度尤其要命。

當前常見的人類數據采集方式里,純第一視角視頻當然成本低、規模大,但精度始終是硬傷。

據靈初披露的方案,他們通過端到端的第一視角手部檢測模型預測MANO參數和位姿,再結合DPVO和Any4D,把軌跡統一到世界坐標系。

即便如此,只靠純第一視角視頻恢復的人手操作軌跡,誤差仍然在毫米級;引入自研外骨骼手套之后,才能壓到亞毫米級。

這也是為什么精細裝配場景對采集精度格外敏感。手機裝配、紙盒插接、精密抓取這類任務,很多時候不是靠「差不多」就能完成,誤差只要再放大一點,動作就會徹底失效。

除了位姿精度,另一條線索是觸覺。

這幾年,觸覺在機器人通用模型里一直是個稀罕物。

因為機器人端的觸覺傳感器本身就難穩定部署,不同硬件廠商的數據格式也不兼容,想把它做成可規模化復用的數據源很難。

但人類側的觸覺采集條件寬松得多,設備更輕,成本也更低。

靈初這次把觸覺看作一條關鍵線索。

人和機器人外形不同、關節不同、動力學不同,但「碰到了沒有」、「接觸發生在什么時候」這類信號,本來就接近一種跨本體的共通語言。

考慮到現實里大多數機器人根本沒有成熟可用的觸覺通道,靈初用了Mask Training的方式:真機數據輸入時把觸覺通道屏蔽掉,讓模型去預測觸覺信號,而不是直接拿它當觀測輸入。

據其披露,引入觸覺后,Psi-W0的表現明顯提升,模型對機器人和物體交互過程的預判能力也更強。

再往下看,真正把實驗室和工廠區分開的,還是節拍。

這也是人類數據被重新看重的另一個原因。

真實工廠里的標準作業流程,往往是長期打磨出來的最優結果,每多一個動作、每慢一個節拍,都可能在規模化生產中被成倍放大。

假設機械臂物理運動上限是 1200,遙操作往往只能做到 800 甚至更低;而人在本職工作中完成操作時,節拍可以逼近機械臂的運動極限。

換句話說,人類數據的價值不只在于采得更便宜,也在于它更貼近真實SOP,更貼近真實作業速度。

對于想走向落地的具身智能模型來說,這種數據天然更接近產業需求本身。

四、1000小時開源數據集

背后是一條更完整的訓練路徑

靈初這次還順手甩出了一套開源數據集。總盤子接近10萬小時的人類操作數據,先開源其中1000小時。

別小看這1000小時。

門道藏在結構里:一類是高精度數據,處理之后軌跡能高度對齊真機,回放性極強;另一類主攻大規模擴展,精度可控,優先把數據量和泛化空間拉滿。

一個管操作精度,一個管預訓練邊界——兩種數據放在同一套體系里,訓練框架才算真正閉環。

順著往下看,這次發布的核心看點,早就不在模型名字、榜單排名或者開源數據本身。

靈初真正亮出來的,是一條完整的訓練路徑:當真機遙操作數據撐不起大規模預訓練,就把人類數據塞進訓練主脈。

但光有人類數據遠遠不夠——得靠策略模型承接,得靠世界模型做反事實推演和強化學習調優,還得有一套轉換機制,把人的動作穩穩當當變成機器人的動作。