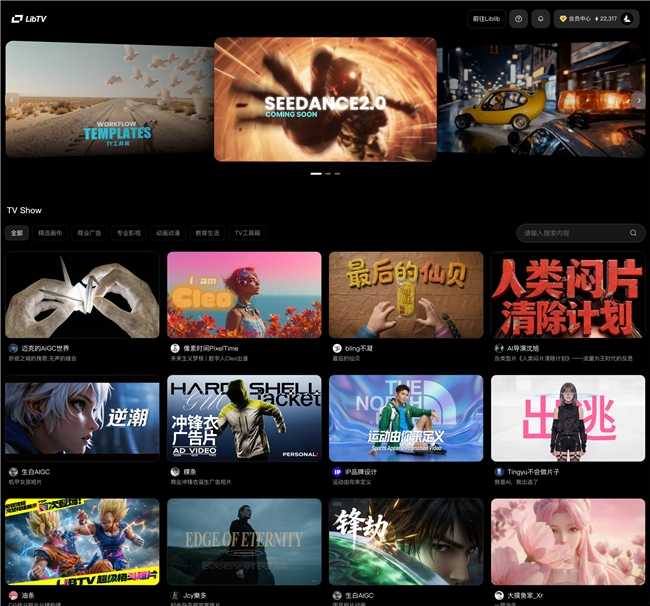

3 月 18 日,LiblibAI 發布 AI 視頻創作平臺 LibTV,上線首日訪問量突破 10 萬。該產品集成可靈 3.0(Kling 3.0)等主流視頻模型,并采用“人類創作者 + AI Agent”的雙入口結構,支持從腳本、分鏡到成片輸出的完整創作流程。產品上線正值視頻模型密集迭代與 OpenClaw 等「龍蝦 Agent」快速擴散階段。

從“生成工具”到“創作系統”,LibTV 的切入方式

LibTV 的核心變化,不在單一模型能力,而在產品結構。

它以“無限畫布 + 節點式工作流”為基礎,將劇本、分鏡、鏡頭、剪輯等環節組織在同一個空間中,使視頻創作從線性操作轉為結構化流程。創作者可以在畫布上逐步搭建內容,并對任意節點進行修改與復用。這種設計更接近影視制作流程,而非傳統 AI 工具的對話式交互。

在能力層面,LibTV 集成了多模態模型體系,包括可靈 3.0、Wan 2.6、Seedream 5.0、Midjourney V7等多模態模型以及 Mureka 音頻生成模型等,覆蓋文本、圖像、視頻與音頻生成。

不同能力不再分散在多個工具中,而是被統一納入同一工作流中。當模型逐漸成為標準配置之后,產品的差異開始體現在如何組織這些能力,以及是否能夠支撐更復雜的創作任務。

LibTV上線了20項獨家功能,頗受專業影視創作者喜愛,包括角色三視圖生成、主體庫(角色一致性管理)、多機位 9/25 宮格、劇情推演 4 宮格、畫面推演(3 秒后 & 5 秒前)、電影級燈光控制(24 種主光位、9 種輪廓光預設)、鏡頭聚焦、9/25 宮格切分。

Agent 成為新入口,軟件開始同時服務“人和 AI”

除了創作結構的調整,LibTV 另一項更受關注的變化,是其“雙入口”設計。在傳統圖形界面之外,LibTV 同時提供面向 AI Agent 的 Skill 接口,使外部 Agent 可以直接調用其視頻生成能力。通過 OpenClaw 等 Agent,用戶可以以自然語言、鏈接或文件作為輸入,由 AI 自動完成從腳本生成、分鏡設計到視頻輸出的全過程。

過去的軟件主要面向人類用戶設計,API 作為補充能力存在;而隨著 Agent 使用的普及,軟件需要同時適配人類操作與 AI 調用兩種路徑。如何讓 Agent 更高效地使用軟件能力,正在成為產品設計中的新問題。

LibTV 將這一問題直接納入產品結構中。

LiblibAI:一條少數公司走通的路徑

在定價上,LiblibAI 展現出一種少見的進攻性。這背后并非短期補貼,而是基于其廣泛的模型與算力合作網絡所形成的成本優勢。

其模型合作伙伴包括豆包大模型、Hailuo AI、可靈 AI、Kimi、Mureka、PixVerse、千問大模型、生數、智譜等,覆蓋視頻生成、圖像生成、多模態理解與音頻創作等多個方向。在基礎設施層面,LiblibAI 同時與阿里云、Google Cloud、火山引擎、騰訊云、亞馬遜云科技等云與算力平臺建立合作關系。

這一組合,使其能夠在不同模型能力之間進行調度與整合,并在成本、性能與可用性之間取得更靈活的平衡。

當多數產品仍受制于單一模型成本結構時,LiblibAI 已經可以通過整合供給側資源,重新定義價格區間。

在當前的 AI 競爭格局中,LiblibAI 代表的是另一種少見但越來越清晰的路線。過去兩年,大多數公司圍繞模型展開競爭,試圖通過更大的參數規模或更強的生成能力建立壁壘。而 LiblibAI 選擇了一條不同的路徑:不做單點能力的極致,而是構建一整套創作基礎設施。

這條路徑的難度更高,但一旦成立,邊界也更大。

從圖像社區起步,聚集模型與創作者;再通過星流等設計 Agent 重構設計流程;再到 LibTV 進入視頻創作,逐步覆蓋更高復雜度的內容生產環節。這條路徑的核心,不是自己做更強的生成能力,而是把分散的模型、工具與流程,組織成一套可持續運轉的創作體系。

這種策略帶來的結果是,LiblibAI 并不直接參與模型競賽,卻在持續吸收整個行業的能力紅利。當 Seedance、可靈等模型不斷迭代時,其能力可以被快速納入系統并轉化為用戶體驗。隨著 AI 創作從“生成能力”轉向“如何完成創作”,圍繞流程、系統與 Agent 協同的產品形態開始成為關鍵變量。

在模型之上,LiblibAI 正在占據一層新的位置。