近日,一場圍繞“AI賦能產業升級與經濟發展”的圓桌對話在產聯智庫舉行,來自學界與產業界的眾多嘉賓齊聚一堂,就AI智能體熱潮、AI與產業融合以及中小企業智能化轉型等核心議題展開深入探討。

北京工業大學教授、IEEE China Council常務理事兼工業合作與創新委員會主席李文正,憑借其在人工智能大模型與高性能異構計算機群計算領域的深厚積累,在對話中分享了諸多前沿觀點。他指出,AI大模型本質上是對人類知識的壓縮與對齊,賦予了機器通用對話和生成的能力。當前,AI大模型正朝著“Agentic AI”階段邁進,構建起“大模型+智能體+環境”的協同生態,對物理和數字世界產生深遠影響。

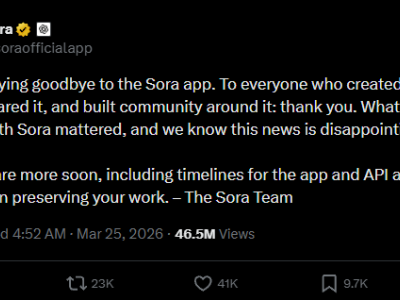

2026年伊始,OpenClaw等開源智能體迅速走紅,引發了行業對“AI獨立上崗”的熱烈討論。業界普遍關注這波熱潮究竟會形成巨頭壟斷的局面,還是開啟一場激烈的混戰。與此同時,Gartner預測多智能體系統將迎來突破,如何界定智能體的能力邊界成為焦點問題。

李文正回顧了人工智能的發展歷程,從判別式AI到生成式AI,再到如今的Agentic AI。他強調,智能體的出現標志著AI大模型從單純的“對話”功能,向“執行真任務”和“解決真問題”轉變。在實現這一轉變的技術路徑上,存在兩條主要路線。一條是以OpenAI GPT5.4為代表的大一統模型,將大模型原生深度集成到工作流中,使GPT - 5.4具備原生電腦操作能力,超越人類,將AI大模型從對話工具轉變為執行智能體;另一條是以Anthropic Claude Opus 4.6為代表的多AI Agent協同大框架。

在產品形態方面,Manus和OpenClaw備受矚目。Manus是全球首款通用型AI智能體,定位為數字員工,主要在云端運行;而OpenClaw是開源的本地AI智能體框架,旨在打造用戶的數字分身,在數字世界中執行任務,主要運行于本地電腦設備。這兩個產品都沒有自有模型,而是依靠大框架、工具與生態與強大模型進行適配和優化。

Agentic AI強調AI系統以高度自治、主動、目標驅動的方式運作,其核心特征包括自治性、感知能力、決策/推理能力、行動能力和目標導向。這使得AI大模型從“對話”邁向“執行”,進而進入“多智能體協同”的新階段,實現從“會說”到“會做”,最終走向“解決真問題,真解決問題”。對于企業而言,這一趨勢既帶來了挑戰,也蘊含著機遇。

李文正認為,AI智能體目前仍處于快速發展的初級階段,未來需要重點關注數字空間智能與物理世界的深度融合。如何讓數字空間智能與現實物理世界建立有意義的聯結,解決符號落地問題,是實現從“會說”到“會做”跨越的關鍵。

在探討Agentic AI時代對未來智慧城市運營與城市基礎設施的影響時,李文正將智慧城市比喻為一個從“能看、能思考”的城市大腦,進化為“能動手、能執行”的城市智能體。這一進化不僅意味著城市運營模式的徹底變革,也對城市智能基礎設施提出了更高要求。

智能體的自主決策與執行能力將推動城市運營實現三大躍遷:運營模式從“被動處置”轉變為“主動預防”;服務體驗從“千人一面”升級為“極致個性化”;管理對象從“物理空間”擴展到“虛實融合”。然而,這些變化也給城市智能基礎設施帶來了四大核心挑戰。

首先是算力架構,需要從“中心化”向“云邊端一體化”的實時協同轉變。智能體需實時處理海量數據并做出毫秒級響應,這就要求算力下沉。例如,一個城市要處理數萬路攝像頭的數據,需構建從云端訓練到邊緣端推理的協同架構,網絡需具備高吞吐、低時延能力。其次是數據治理,要從“部門孤島”走向“全域融合”的語義理解。智能體要理解復雜城市事件,必須打破部門之間的數據壁壘,實現跨模態數據的融合,以便即時檢索和理解歷史數據并做出精準決策。再者是信任體系,要從“技術工具”轉變為“權力代理”的倫理對齊。當智能體自主控制交通信號或派遣應急資源時,它實際上成為了“權力代理”,這帶來了尖銳的挑戰,即人們是否敢使用它。這就要求基礎設施內置可解釋性、偏見檢測機制,并通過數字孿生沙盤先模擬驗證再執行。最后是容錯標準,要從“體驗降級”轉變為“生命攸關”的零故障容忍。對話問答場景出錯只是體驗問題,但交通指揮或應急調度出錯則可能危及生命,這意味著城市核心系統對智能體的容錯度極低。

在降低大模型幻覺方面,李文正提到,新加坡國立大學和OpenAI發表的文章指出幻覺是大語言模型固有的局限性。為了減少AI幻覺,增強模型的邏輯推理能力是一種方法,但這會增加對算力的消耗,因此如何減少大模型幻覺成為研究熱點。他引用丹尼爾·卡內曼的雙系統理論,指出人腦存在直覺思維的“快思考”和理性思維的“慢思考”。受此啟發,以OpenAI o1、DeepSeek - R1等為代表的推理模型通過“鏈式思維”或自我反思機制等技術路徑,有效提升了復雜推理任務的解決能力,減少了幻覺。思維鏈是一種引導AI模型進行分步推理的技術,本質是強迫模型從“快思考”切換到“慢思考”。然而,如何讓模型在減少幻覺的同時,降低“思考成本”,成為研究的關鍵。李文正表示,平衡模型性能與算力成本的關鍵在于“動態決策”與“架構創新”。具體而言,可以從模型設計、推理策略和工程優化三個層面入手。模型設計上,從“通用全能”轉向“專家分工”,混合專家模型(MoE)是目前解決模型性能與成本矛盾的主流范式;推理策略上,從“簡單堆算力”轉向“動態優化”,結合“快思考”和“慢思考”的思想,讓模型優先調用快速模式,遇到邏輯復雜問題場景時再切換至慢速、高精度的推理模式;工程優化上,從“硬件堆料”轉向“榨干性能”,在硬件和工程層面進行優化,用“數學補物理”。

李文正還指出,在Agentic AI時代,算力決定速度,內存決定上限。人工智能大模型作為AI基礎設施,計算重點正從“浮點運算量”轉向“邏輯編排效能”,從“大規模矩陣運算”轉向“高頻交互式協調計算”,計算范式發生躍遷和結構性變革,CPU已從“通用處理器”轉型為Agentic AI時代高頻交互式AI推理優化處理器。AI大模型推理需要與大模型推理相適配的處理器,因為在推理的Prefill階段是計算密集型的,而在Decode階段則是存儲密集型的。當對話達到數萬乃至百萬token時,KV - Cache會爆炸式增長,系統需要從內存中調取海量歷史數據,形成“推理內存墻”,“內存主導型”工作負載,內存決定了計算性能的上限。推理直接面向最終用戶,對延遲、吞吐量和成本有極其嚴苛的要求,因此Agentic AI時代對大模型推理計算相適配的算力芯片低時延提出了極致要求,計算與存儲效率成為衡量系統整體性能的重要因素。

為了解決“推理內存墻”和“推理延遲”問題,近存計算成為關注熱點。Groq推出的LPU憑借在SRAM片上實現近存計算,消除HBM訪存瓶頸,成為AI大模型推理加速的近存計算AI芯片。在Agentic AI元年,英偉達收購Groq,獲取其LPU推理技術與Rubin GPU通過極致協同設計,由Rubin GPU負責大規模并行計算的Prefill階段,LPU專門負責Decode階段,以實現低延遲的Token生成,精準適配大模型推理計算需求。Cerebras Systems公司通過將海量計算核心和高速片上存儲(SRAM)集成在一起,極大減少了芯片間通信開銷,在特定AI推理任務中實現了比傳統GPU集群高數十倍的運算速度;Taalas公司則專注于開發“模型專用集成電路”(MSIC),將大模型直接固化在硬件中實現極致推理性能,其首款產品HC1芯片在制造過程中將模型權重直接硬編碼到芯片的晶體管電路中,使模型成為專用集成電路(ASIC)模型即芯片。

在算力需求呈指數級增長的背景下,如何應對電力供應的挑戰,實現算力與電力的可持續發展也是重要議題。全球AI大模型技術發展迅速,模型參數量呈指數級增長。以OpenAI的GPT系列為例,從GPT - 3的1750億參數發展到GPT - 4的預估1.7萬億參數規模,再到GPT - 5可能達到3至50萬億參數。在Scaling law驅動下,科技巨頭持續挑戰Scaling Law極限,大模型海量計算對算力需求爆炸式增長,傳統的數據中心無法滿足需求,數據中心擴展和電力供應成為關注焦點。美國xAI超級計算機Colossus2投入運行,開啟全球首個吉瓦級規模的AI訓練集群,最近xAI獲批部署41臺天然氣輪機,發電容量約1.2吉瓦為Colossus 2數據中心供電。高性能超級節點及集群是實現大模型scaling laws的最佳方法,高性能計算集群從千卡、萬卡邁入十萬卡大關,多家AI巨頭陸續宣布或者完成10萬卡集群。面對10萬卡集群,電力與算力深度耦合,電力供應成為新挑戰。OpenAI和英偉達聯合發布的研究顯示,隨著AI大模型訓練規模急劇擴張至數萬GPU集群,其功耗的劇烈波動對數據中心基礎設施構成挑戰,單個訓練任務的功率波動可達數十兆瓦級別,威脅數據中心供電穩定,甚至可能對整個電網系統造成潛在風險。為應對這一挑戰,我國推動算力 - 電力協同,實現算力調度與智能化運營,發改委等三部門印發相關行動方案,實施一批算力與電力協同項目。同時,李文正提出“算力與電力協同”的解決方案,建議利用AI賦能電力調度優化,依托“東數西算”戰略,探索太空數據中心、海底數據中心等新型數據中心基礎設施,通過系統優化積極應對挑戰。