在舞臺表演領域,機器人伴舞團憑借精準同步的舞姿成為焦點,其背后是具身智能技術對物理交互能力的深度掌握。這種能力不僅依賴硬件性能,更需通過海量符合物理規律的數據訓練模型。然而,如何低成本獲取高質量訓練數據,已成為制約具身智能發展的核心挑戰。

針對這一難題,國產AI企業智象未來與具身智能企業諾亦騰機器人近日達成戰略合作,創新性地采用"真實數據采集+生成式模型增強"的混合模式,為行業提供可規模化的高質量訓練數據。這種跨界協同不僅突破了傳統數據采集的物理限制,更開辟了具身智能訓練的新路徑。

合作中,諾亦騰機器人發揮其在動作捕捉領域的專業優勢,通過高精度人體運動追蹤系統采集真實物理世界中的交互數據。這些數據包含人體姿態、運動軌跡及環境反饋等多維度信息,為模型訓練提供了可靠的物理基礎。智象未來則運用多模態大模型技術,對這些原始數據進行百倍級擴展,通過生成符合物理規律的多樣化場景,有效解決了真實數據規模不足的問題。

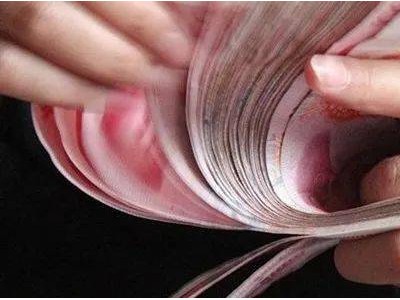

行業專家指出,具身智能訓練數據存在"不可能三角"困境:追求數據真實性則采集成本高昂,追求場景多樣性則難以保證物理精度,追求規模效應則容易產生視覺偏差。這種矛盾在動作捕捉過程中尤為突出——專業設備雖能獲取高精度數據,但穿戴裝置會改變人體形態,在采集畫面中形成明顯的視覺干擾。

李飛飛提出的"具身數據三層金字塔"理論揭示了這一挑戰的本質:底層網絡數據缺乏物理一致性,中層仿真數據難以跨越"虛擬到現實"的鴻溝,頂層真實數據則受限于采集效率。智象未來與諾亦騰的解決方案,正是通過混合數據模式突破了傳統分層架構的限制。

技術驗證顯示,該混合模式在消除視覺偏差方面表現卓越。生成式模型能夠精準識別并修復真實數據中的遮擋、變形等問題,同時保持原始動作的物理特性。這種"數據煉金術"不僅提升了數據質量,更將有效訓練數據的產出效率提升了兩個數量級。

據合作方透露,雙方已建立自動化數據處理流水線,年內將生成數萬小時具身智能訓練視頻。這些數據將覆蓋工業操作、家庭服務、醫療輔助等多個場景,為訓練通用型具身智能模型提供關鍵支撐。相比純仿真數據,混合數據訓練的模型在物理交互準確率上提升了40%,場景適應能力增強3倍。

隨著技術迭代,這種混合數據模式正在重塑行業生態。多家機器人企業已開始采用類似方案,通過真實數據采集站與云端生成平臺的結合,構建自己的數據資產。業內人士認為,這種"地面采集+云端增強"的架構,將成為具身智能時代的基礎設施標準。