3D數(shù)字人行業(yè)已陷入發(fā)展怪圈:全行業(yè)的競爭維度,始終困在"視覺上夠不夠像人"的顏值內(nèi)卷里。但行業(yè)集體忽略的是,再精致的建模、再逼真的渲染,都無法成為用戶長期深度交互的核心理由。

真正卡住數(shù)字人產(chǎn)業(yè)發(fā)展天花板的,從來不是視覺層面的"不像人",而是其始終未能構(gòu)建起與人類相似自然的表達(dá)能力和更流暢的動作。很多時候,數(shù)字人看似嘴在動、手在揮,肢體動作卻與對話語義完全脫鉤,面部表情和臺詞情緒徹底割裂,這種深入骨髓的機械感與違和感,直接斬斷了人與數(shù)字人之間建立情感聯(lián)結(jié)、實現(xiàn)深度交互的所有可能。

人類真實溝通中,超70%的信息與情緒都藏在非語言信號里,聳肩的無奈、挑眉的質(zhì)疑,這些細(xì)節(jié)才是對話的靈魂。但這背后是行業(yè)面臨的三個瓶頸:一是中文對話場景高質(zhì)量數(shù)據(jù)荒,覆蓋全身動作的高質(zhì)量數(shù)據(jù)集近乎空白;二是復(fù)合語義下動作漂移,面對融合情緒的復(fù)雜表達(dá),模型語義理解能力急劇退化;三是音畫節(jié)奏錯位,動作機械生硬,與語音重音、停頓完全脫節(jié)。

這三道枷鎖,把數(shù)字人困在"預(yù)設(shè)腳本播放機器"的定位里,始終邁不開從"能說話"、"能動"到"懂交流"的關(guān)鍵一步。而SentiPulse(思維光譜)聯(lián)合中國人民大學(xué)高瓴人工智能學(xué)院推出的SentiAvatar交互式3D數(shù)字人框架,正是為打破這些瓶頸而來。面向全球開源的3D動作生成完整解決方案,讓數(shù)字人跳出預(yù)設(shè)動作桎梏,實現(xiàn)貼合語境與情緒的自然實時交互,真正告別"提線木偶"式交互。

國內(nèi)首個交互式3D數(shù)字人框架,讓3D數(shù)字人動作有"靈魂"

針對行業(yè)底層痛點,SentiAvatar打造了3D動作生成新范式。

在數(shù)據(jù)底座層,SuSuInterActs數(shù)據(jù)集圍繞單一角色SUSU(22歲,溫柔活潑,情感豐富)構(gòu)建。包含2.1萬段片段、37小時的多模態(tài)對話語料,涵蓋同步語音、行為標(biāo)注文本、全身動作與面部表情,填補中文高質(zhì)量數(shù)據(jù)的空白。

為打破場景限制,讓數(shù)字人交互擺脫"腳本化",團隊在預(yù)訓(xùn)練階段引入了自研的Motion Foundation Model動作基礎(chǔ)模型,在200K+條異質(zhì)動作序列(約676小時)上訓(xùn)練通用運動先驗,讓數(shù)字人的能力遠(yuǎn)超對話場景本身。

此外,SentiAvatar創(chuàng)新提出plan-then-infill雙通道并行架構(gòu),在動作生成時,將身體動作與面部表情分開處理,先規(guī)劃"做什么動作",再插入"如何逐幀執(zhí)行",讓整體動作生成效果更流暢。

具體而言,第一階段,LLM語義規(guī)劃器接收行為標(biāo)簽文本和稀疏音頻Token,輸出稀疏關(guān)鍵幀動作Token序列。為支持多輪流式連續(xù)生成,模型以前一句話的最后兩個關(guān)鍵幀音頻-動作Token對作為上下文前綴,從下一個關(guān)鍵幀位置續(xù)寫,實現(xiàn)無縫跨句過渡;第二階段,Body Infill Transformer在相鄰關(guān)鍵幀之間填入中間3幀,以逐幀 HuBERT連續(xù)特征(768維,20FPS)作為條件信號。模型采用5幀滑動窗口,首尾幀已知,預(yù)測中間3幀(12個動作Token)。推理時使用迭代置信度解碼策略(默認(rèn)6步),逐步接受高置信度預(yù)測,避免一次性預(yù)測的質(zhì)量退化。

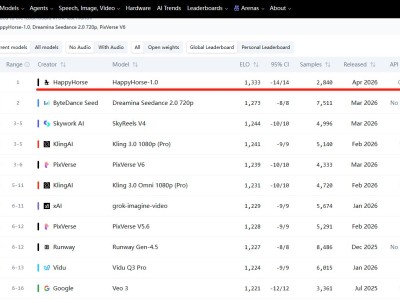

權(quán)威實驗結(jié)果顯示,SentiAvatar在SuSuInterActs和行業(yè)通用BEATv2兩個數(shù)據(jù)集上,多項核心指標(biāo)均達(dá)到當(dāng)前國際最優(yōu)水平(SOTA),性能全面領(lǐng)跑行業(yè)主流模型。

在自建的SuSuInterActs測試集上,SentiAvatar的文本-動作檢索召回率R@1達(dá)到43.64%,幾乎是行業(yè)次優(yōu)基線的2倍;在跨數(shù)據(jù)集、跨語言的BEATv2評測集上,SentiAvatar以FGD 4.941、BC 8.078的成績,同時刷新兩項指標(biāo)的SOTA紀(jì)錄,超越此前行業(yè)最優(yōu)方案,充分驗證了模型的跨場景、跨語言泛化能力。

基于自研高質(zhì)量數(shù)據(jù)集、動作基礎(chǔ)模型與核心架構(gòu),SentiAvatar實現(xiàn)了在0.3秒內(nèi)生成6秒動作序列,支持無限輪次的流式交互。這意味著數(shù)字人可以在實時對話中持續(xù)生成連貫的動作與表情,無需等待整句結(jié)束再批量處理,能直接解決數(shù)字人"交互卡頓"的問題。

構(gòu)建認(rèn)知-表達(dá)閉環(huán),夯實數(shù)字人"交互底座"

SentiAvatar已正式上線GitHub開源平臺,面向全球科研機構(gòu)與開發(fā)者全面開放,相關(guān)技術(shù)報告也已同步發(fā)布于arXiv。開發(fā)者可基于這套開源框架,低成本打造專屬的3D數(shù)字人,也可拓展其在游戲交互、影視制作、機器人等領(lǐng)域的應(yīng)用。

當(dāng)數(shù)字人不再是冰冷機械的交互工具,它能讀懂你面部表情的隱喻并反饋同樣稀缺的情緒價值,變成能感知語境、理解情緒、主動表達(dá)的交互主體,下一代"數(shù)字生命"即將誕生。