人工智能技術(shù)的快速發(fā)展,讓AI助手在日常生活中的應(yīng)用越來越廣泛。然而,如何確保這些智能系統(tǒng)在面對復(fù)雜場景時依然遵守安全邊界,成為全球研究者關(guān)注的焦點。近期,一支跨國科研團隊提出了一種名為“選擇性引導(dǎo)”的創(chuàng)新技術(shù),通過精準干預(yù)AI的決策過程,實現(xiàn)了對有害行為的實時控制,同時保持了系統(tǒng)的原有性能。

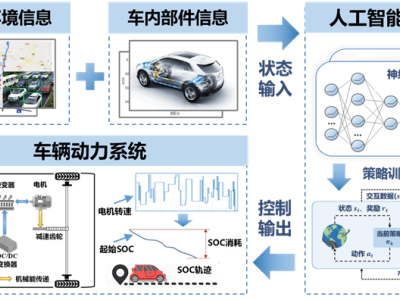

傳統(tǒng)方法在應(yīng)對AI安全問題時,往往需要重新訓(xùn)練整個模型,既耗時又可能影響其他功能。研究團隊另辟蹊徑,將AI模型的工作機制類比為工廠流水線,發(fā)現(xiàn)不同層次對應(yīng)著語言理解、邏輯推理等不同功能。通過深入分析發(fā)現(xiàn),AI在處理“有害”和“無害”請求時,中間層次的神經(jīng)元激活模式呈現(xiàn)“正負相反”的特征,就像工廠中專門負責質(zhì)檢的關(guān)鍵環(huán)節(jié)。研究人員將這些層次定義為“判別層”,并證實只需調(diào)整這些區(qū)域即可有效控制行為。

數(shù)學(xué)實現(xiàn)上的突破是該技術(shù)的核心創(chuàng)新。早期調(diào)整方法在改變信息方向時,會無意中破壞信息總量,導(dǎo)致輸出混亂。研究團隊通過嚴格的數(shù)學(xué)推導(dǎo),開發(fā)出基于“旋轉(zhuǎn)”的調(diào)整方法,如同在二維平面上精準轉(zhuǎn)動方向盤而不改變車速。這種操作既能保持信息流的穩(wěn)定性,又具備可逆性,允許隨時撤銷調(diào)整效果,為系統(tǒng)安全性提供了雙重保障。

實驗驗證覆蓋了九個主流AI模型,包括Llama、Qwen和Gemma三大系列,參數(shù)規(guī)模從15億到90億不等。測試結(jié)果顯示,新技術(shù)在小型模型上的行為控制成功率比傳統(tǒng)方法提升5.5倍,在Qwen2.5-1.5B模型上從13.46%躍升至74.04%。更關(guān)鍵的是,所有模型在數(shù)學(xué)推理、常識問答等核心能力測試中均保持了原始水平,徹底解決了傳統(tǒng)方法“治標不治本”的缺陷。

對比實驗進一步證明了精準定位的重要性。當隨機選擇調(diào)整層次時,系統(tǒng)成功率接近零;即使選擇所有層次,雖然能改變行為,但會導(dǎo)致輸出大量無意義文本。而數(shù)學(xué)精確性同樣關(guān)鍵,在相同判別層選擇下,有缺陷的舊方法在Qwen2.5-3B模型上完全失效,新方法卻達到84.6%的成功率。這些數(shù)據(jù)清晰地表明,每個技術(shù)環(huán)節(jié)都不可或缺。

該技術(shù)的實時調(diào)整特性具有顯著應(yīng)用價值。相比需要數(shù)周重新訓(xùn)練的傳統(tǒng)方案,選擇性引導(dǎo)可在AI運行時即時生效,大幅降低了安全控制的實施成本。研究團隊已公開所有代碼和實驗細節(jié),這種開放態(tài)度將加速技術(shù)迭代。目前,團隊正在探索更復(fù)雜的特征提取方法,以應(yīng)對不同架構(gòu)AI模型的特殊需求,例如某些模型呈現(xiàn)出的雙峰控制模式暗示可能存在多重決策機制。

這項突破為AI安全領(lǐng)域提供了全新范式。通過深入解析AI的“思考過程”,研究者找到了既保持智能水平又約束行為的平衡點。計算復(fù)雜度從原來的與總層數(shù)相關(guān),優(yōu)化為僅與判別層數(shù)量相關(guān),這種效率提升使得技術(shù)具備大規(guī)模應(yīng)用潛力。正如研究論文所展示的,當精密手術(shù)取代整體重建,AI安全控制終于找到了可靠的技術(shù)路徑。