近日,一份名為“OpenClaw AI Agent 小龍蝦能力排行榜”的最新評測結果在AI圈刷屏。該榜單專注于真實場景,專門測試各大主流大模型在OpenClaw框架下執行實際編碼任務的成功率,為開發者挑選AI Agent提供了硬核參考。

標準化測試方法揭秘

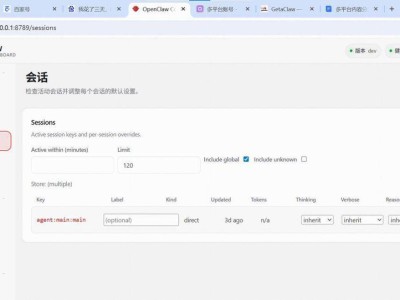

本次評測采用一套統一的OpenClaw Agent任務集,通過自動化代碼檢查結合LLM智能評審的雙重機制進行打分,確保結果客觀、可復現、零人工干預。所有模型均在相同框架、相同任務難度下公平競技,真正衡量“誰能真正把代碼寫對、跑通”。

前三強震撼出爐

根據最新榜單,前三名依次為:

1. Gemini3Flash Preview

2. MiniMax M2.1

3. Kimi K2.5

這三款模型在復雜編碼Agent任務中表現出色,成功率遙遙領先,展現出極強的實用落地能力。

Claude家族集體爆發

緊隨其后的是Claude Sonnet4.5、Gemini3Pro Preview、Claude Haiku4.5以及Claude Opus4.6。其中,Claude家族三款模型成功率全部突破90%,成為本次評測的最大贏家,充分證明其在長鏈路、多步推理編碼任務中的穩定統治力。

GPT-5.2與DeepSeek表現意外

與Claude家族的強勢形成鮮明對比,GPT-5.2本次僅取得65.6%的成功率,排名大幅落后;而DeepSeek V3.2則穩定在82%左右,處于中游水平。這一結果也再次提醒業界:參數規模與實際Agent能力并非完全正相關,框架適配與任務執行效率才是王道。

AIbase點評

OpenClaw“小龍蝦”排行榜用最硬核的編碼實戰,揭開了當前大模型在Agent時代的真實實力差距。無論你是開發者還是企業AI負責人,這份榜單都值得立刻收藏參考。AIbase將持續追蹤OpenClaw框架及各大模型的最新動態,我們獲取第一手評測解讀!