螞蟻開源近日宣布推出全新旗艦級(jí)即時(shí)模型——Ling-2.5-1T,這款擁有萬(wàn)億參數(shù)的大模型在智能效率與效果平衡方面實(shí)現(xiàn)重大突破,標(biāo)志著AGI技術(shù)向更普惠的方向邁進(jìn)。作為百靈家族最新成員,Ling-2.5-1T通過架構(gòu)創(chuàng)新與多維度優(yōu)化,在復(fù)雜任務(wù)處理能力上達(dá)到行業(yè)領(lǐng)先水平。

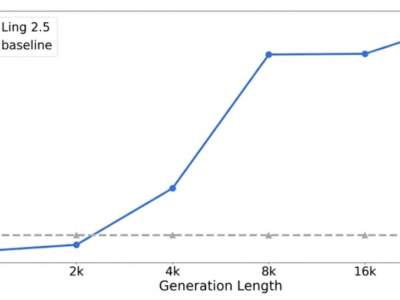

該模型采用混合線性注意力架構(gòu),總參數(shù)規(guī)模達(dá)1T(激活參數(shù)63B),預(yù)訓(xùn)練語(yǔ)料庫(kù)從20T擴(kuò)展至29T。通過精細(xì)化的數(shù)據(jù)策略優(yōu)化,Ling-2.5-1T可高效處理長(zhǎng)達(dá)1M token的上下文信息,在長(zhǎng)文本處理任務(wù)中展現(xiàn)出卓越性能。特別引入的"正確性+過程冗余"復(fù)合獎(jiǎng)勵(lì)機(jī)制,使模型在保持高token效率的同時(shí),推理能力較前代提升顯著,接近需消耗4倍輸出token的前沿思考模型水平。

在偏好對(duì)齊方面,研發(fā)團(tuán)隊(duì)創(chuàng)新性地采用雙向強(qiáng)化學(xué)習(xí)反饋與Agent-based指令約束校驗(yàn)技術(shù)。這些精細(xì)化策略使模型在創(chuàng)意寫作、指令遵循等任務(wù)中的表現(xiàn)較前代提升37%,尤其在需要深度理解用戶意圖的場(chǎng)景中表現(xiàn)突出。通過大規(guī)模高保真交互環(huán)境訓(xùn)練,Ling-2.5-1T原生支持智能體交互,可無縫適配Claude Code、OpenCode等主流智能體產(chǎn)品,在BFCL-V4通用工具調(diào)用基準(zhǔn)測(cè)試中取得開源模型最佳成績(jī)。

全面基準(zhǔn)測(cè)試顯示,Ling-2.5-1T在知識(shí)儲(chǔ)備、邏輯推理、智能體協(xié)作等核心維度均實(shí)現(xiàn)跨越式發(fā)展。與百靈家族前代模型Ling-1T相比,新模型在所有評(píng)估項(xiàng)目中均呈現(xiàn)明顯優(yōu)勢(shì);在與DeepSeek V3.2、Kimi K2.5等主流大模型的對(duì)比中,其復(fù)雜推理與指令執(zhí)行能力尤為突出,展現(xiàn)出在專業(yè)領(lǐng)域落地的巨大潛力。

目前,Ling-2.5-1T已通過Hugging Face(https://huggingface.co/inclusionAI/Ling-2.5-1T)和ModelScope(https://modelscope.cn/models/inclusionAI/Ling-2.5-1T)雙平臺(tái)開源發(fā)布。研發(fā)團(tuán)隊(duì)表示,將持續(xù)優(yōu)化模型性能并拓展應(yīng)用場(chǎng)景,為全球開發(fā)者提供更強(qiáng)大的AI基礎(chǔ)設(shè)施支持。此次開源將加速AGI技術(shù)在醫(yī)療、教育、金融等領(lǐng)域的創(chuàng)新應(yīng)用,推動(dòng)智能技術(shù)向更廣泛的人群普及。