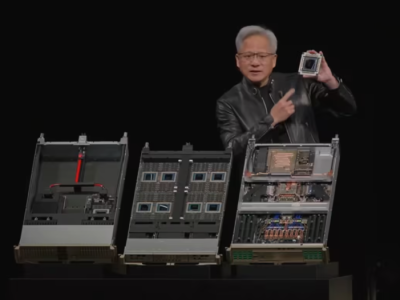

在近日舉辦的英偉達GTC 2026大會上,英偉達創始人兼首席執行官黃仁勛身著標志性皮衣亮相,宣布公司正從“芯片公司”向“AI基礎設施工廠”全面轉型。他透露,到2027年,英偉達新一代AI芯片的累計營收將突破1萬億美元,這一數字是去年預測的兩倍,引發市場高度關注。

本次大會的核心亮點是Vera Rubin AI工廠平臺的發布。與以往發布單芯片不同,此次展示的是一個包含7款全新芯片的“全家桶”系統。黃仁勛強調:“過去提到Hopper,我會舉起一塊芯片,那很可愛。但提到Vera Rubin,大家想到的是整個系統。”

該系統級平臺的核心組件包括專為“AI智能體時代”設計的Vera CPU,其搭載88個自研“Olympus”核心,性能較傳統CPU提升50%,能效翻倍,被比作智能體系統的“指揮與調度中心”。Rubin GPU則通過NVLink-C2C技術與Vera CPU實現1.8TB/s的互聯帶寬,構成算力核心。平臺還集成了NVLink 6 Switch、ConnectX-9 SuperNIC、BlueField-4 DPU以及帶同包光學器件的Spectrum-X可擴展交換機,形成完整的超高速互聯、網絡與數據處理基礎架構。

基于這些組件構建的Vera Rubin NVL72機架集成了72顆Rubin GPU和36顆Vera CPU。相比上代Blackwell平臺,其訓練大型混合專家模型所需GPU數量減少至四分之一,推理吞吐量/瓦特提升高達10倍。黃仁勛透露,通過軟硬件協同設計,英偉達在兩年內將1GW數據中心內的Token生成速率提升了350倍。

大會上,黃仁勛還重點介紹了一款戰略級芯片——Groq 3語言處理單元(LPU)。這款芯片源自英偉達去年12月以約200億美元收購Groq核心技術資產,被定位為Rubin GPU的“推理協處理器”。黃仁勛解釋,引入LPU是為了應對AI智能體時代推理需求的分化:面對需要極高交互性、超短響應時間的任務,傳統GPU架構存在性能冗余,而LPU專注于“極致低延遲Token生成”。

Groq 3 LPU的技術顛覆性在于其內存架構。每個芯片集成500MB片上SRAM,提供高達150TB/s的帶寬,是傳統HBM4帶寬(22TB/s)的近7倍。盡管容量僅為Rubin GPU上HBM4的1/500,但對于帶寬敏感的AI解碼操作,LPU的優勢無可替代。基于此芯片的Groq 3 LPX機架配備256顆LPU,提供128GB片上SRAM和640TB/s總帶寬。

英偉達超大規模計算副總裁Ian Buck指出,LPU與GPU的協同工作將重新定義AI推理架構:Rubin GPU負責需要海量計算的“預填充”階段,Groq LPU負責延遲敏感的“解碼”階段。在這種混合架構下,系統推理吞吐量與功耗比最高可提升35倍。黃仁勛建議企業客戶,若工作負載包含大量高價值Token生成需求,應將25%的數據中心規模配置給Groq LPU。

三星電子在本次大會上扮演了重要角色。黃仁勛特別感謝三星為英偉達加快生產Groq 3 LPU芯片,并透露該芯片將于2026年第三季度正式出貨。這一合作標志著三星與英偉達的伙伴關系從存儲領域擴展到晶圓代工領域。三星當天展出了第七代HBM產品“HBM4E”和垂直堆疊芯片“核心裸片”,強調其在存儲和代工領域的雙重優勢。

然而,SRAM的高成本和芯片面積占用問題也帶來挑戰。單個Groq 3 LPU僅能提供500MB內存,遠不足以獨立運行萬億參數級別的超大AI模型。英偉達的解決方案是通過數量彌補容量:將256顆LPU集成到一個Groq 3 LPX機架中,采用液冷設計,并通過專用擴展接口實現芯片互聯。Ian Buck承認,這種設計需要大量芯片才能獲得高性能,從每芯片的token吞吐量經濟性來看,LPU其實相當低。

在混合架構的協同工作方面,大語言模型的推理過程分為預填充和解碼兩個階段。預填充階段需要強大浮點運算能力和大容量內存存儲鍵值緩存,由Rubin GPU負責;解碼階段對延遲極度敏感,受內存帶寬限制嚴重,由Groq LPU處理。在Dynamo軟件框架的協調下,Rubin GPU利用其288GB HBM4處理復雜計算,Groq LPU利用其150TB/s帶寬實現極低延遲的逐token生成。

隨著AI從單一大模型走向多智能體系統,推理延遲的要求發生根本性變化。Ian Buck表示,Rubin GPU和Groq LPU的組合將人工智能代理間通信的吞吐量從每秒100個token提升到每秒1500個token甚至更高。根據英偉達官方基準測試,運行1萬億參數規模的大語言模型時,該組合相比上代方案推理吞吐量每瓦特提升高達35倍,每百萬token成本為45美元,每秒token處理量達到500。

分析認為,收購Groq技術并將其整合到Rubin平臺,是英偉達對推理市場競爭者的直接回應。長期以來,英偉達在訓練市場占據主導,但在低延遲推理領域面臨Cerebras等挑戰者的競爭。Cerebras的晶圓級引擎同樣集成大量SRAM,為先進模型提供低延遲推理,甚至吸引了OpenAI等大客戶。通過引入Groq LPU,英偉達終于進入了推理市場——一個它從未成為第一的市場。

對于現有英偉達客戶而言,Groq LPU的一個重要優勢是軟件兼容性。Groq 3 LPX機架與Rubin平臺的結合無需修改現有的NVIDIA CUDA軟件生態系統,企業客戶可以在不重寫代碼的前提下,通過增加LPU機架顯著提升推理性能。PCMag預測,OpenAI、Anthropic、meta等大型AI公司將成為這項技術的首批采用者,未來用戶的聊天機器人查詢或圖像生成請求可能正由Rubin GPU和Groq LPU協同處理。