編輯:好困 Aeneas

大瓜驚爆AI圈:昨天Cursor新模型剛剛封神,24小時內卻被扒是套殼Kimi?全網秒變吃瓜現場,馬斯克、龍蝦之父都來圍觀了。這一次,中國開源模型,真的上大分了!

今天,整個AI圈都被這個大瓜震驚了。

3月19日凌晨,估值即將沖擊500億美元的AI編程獨角獸Cursor,高調發布了自家最新編程模型Composer 2。

這個模型一發布,立刻在整個開發者社區引發了轟動!

據說,它不僅超越了Claude Opus 4.6,價格還直接腰斬,對于動輒被Claude天價模型燒穿錢包的開發者,這簡直是重大利好啊。

最令業內側目的,就是這張「性能/價格比」坐標軸了:Composer 2直接橫掃了Opus 4.6和GPT-5.4

超越Opus 4.6,這個令人吃驚的成績是怎么得到的?

根據Cursor官方博客的說法,他們采用了不少關鍵技術,比如繼續預訓練、大規模強化學習、自主研發的自我摘要技術。

總之,靠自主研發造出最前沿模型的Cursor,這波是上大分了!

結果,不到24小時,Cursor竟然就被啪啪打臉了??

一行模型ID

撕開500億美元估值的遮羞布

一位名叫Fynn的開發者在調試Cursor的API時,截獲了一段不該出現的模型ID:

accounts/anysphere/models/kimi-k2p5-rl-0317-s515-fast

注意看這段——「kimi-k2p5-rl」。

翻譯過來就是,這個光環滿滿的Composer 2,底下跑的其實是Kimi K2.5的強化學習版本!

瞬間,這條推文迅速就引爆開發者社區,瀏覽量直接飆過22萬。

看熱鬧不嫌事大的馬斯克立馬下場,在評論區留了一句話:「Yeah, it's Kimi 2.5」。

預訓練負責人,在線打假

隨后,Kimi的預訓練負責人立即發推表示,我們測試了Composer 2的分詞器,發現它跟Kimi的完全一致!

幾乎可以確認,這就是我們的模型被進一步后訓練的結果!

他直接@了Cursor的聯創Michael Truell,詢問對方為何沒有遵守他們的MIT License許可條款,也沒有支付任何費用?

后續已經刪帖

要知道,這件事情的核心焦點就在于,根據Kimi K2.5的許可證要求,當衍生產品月收入超過2000萬美元時,需在界面顯著展示「Kimi K2.5」字樣。

而Cursor的年收入超過20億美元,月收入約1.66億,是觸發署名義務門檻(2000萬美元)的8倍以上。

這一波,Cursor算是丟臉丟大發了。社區的各個大V,都下場圍觀、轉發、熱議起來。

連龍蝦之父,都開始下場吃瓜了。

全網都在瘋狂刷起梗圖。

Cursor緊急回應

承認了,但只承認一半

面對鋪天蓋地的質疑,Cursor聯合創始人Aman Sanger不得不下場發聲。

他的回應分三層。

第一,承認基座:我們評估了大量基座模型的困惑度,Kimi K2.5表現最強。

第二,強調自研成分:在K2.5基礎上做了繼續預訓練和4倍算力規模的高強度RL訓練。

第三,道歉:沒在博客里提到Kimi基座,確實是疏忽,下一個模型會改。

Cursor的另一位核心成員Lee Robinson則在幾個小時內連發四條推文,姿態一條比一條低。

最初,他只承認是基于開源項目,并且甩出一組數據稱,最終模型的算力消耗中,只有約1/4來自基座模型,剩下3/4全是Cursor自己的訓練。

所以跑分結果和原版差異很大。

言下之意:我們不是簡單套殼,開源模型只是基礎。

然后架不住社區追問,直接攤牌:「既然大家非要我說出這個名字——KIMI K2.5!!沒錯,就是我們的起點。」

最終,在兩個小時之后,和另一位聯創Aman Sanger在同一時間發了道歉。

他表示,開始沒在博客中提到Kimi基座模型,的確是犯錯了,以后一定改正。

態度還算誠懇,但問題在于——發布時為什么不說?

最終,Kimi也非常大度地下場和解,表示非常自豪看到K2.5為Composer 2提供基座。

至此,事情徹底圓滿了。

此前已有前科

2025年10月,Composer 1 發布時,全球多地用戶就曾反饋:這個宣稱自研的編程助手,竟然在思考過程中偶爾蹦出地道的中文。

即便經幾家媒體證實,Cursor及其競爭對手Windsurf確實都在底層套用了經過微調的中國開源大模型,但Cursor選擇了冷處理——不解釋、不回訪,然后,在今年2月迅速迭代到1.5版本。

但這一次,Composer 2的翻車更加徹底,可以說分明是利用別人研發投入進行的「利潤套利」。

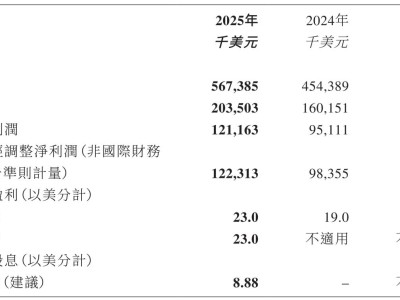

目前,Cursor的估值是293億美元,正尋求500億美元融資;而提供底層能力的Kimi,上輪估值為43億美元。

以此在二級市場上換取12倍估值的操作,就更是令人嘆為觀止了。

Cursor為什么偏偏選了Kimi K2.5?

話說回來,開源模型那么多,Cursor為什么選Kimi K2.5當基座?

答案可能沒那么復雜。

在Artificial Analysis的綜合排行榜上,K2.5就是當前最強的開源模型之一。

從官方公布的跑分來看,K2.5在Agent能力上也是壓過了一眾閉源巨頭。

Humanity's Last Exam得分50.2,GPT-5.2只有45.5,Claude Opus 4.5是43.2;BrowseComp拿到74.9,把GPT-5.2的65.8甩開了近10個點。

在圖像和視頻理解上同樣全面領先,MathVision 84.2分排名第一,VideoMMMU和LongVideoBench也都拿到了最高分。

架構上,K2.5是一個萬億參數的MoE模型,但每次推理只激活320億參數,用不到總量3.2%的算力撐起前沿級的能力。256K上下文窗口,原生支持文本、圖像、視頻三模態輸入。

編碼能力是K2.5最突出的長板,尤其是前端開發場景。比如,給它一張UI設計稿,K2.5能直接輸出帶交互動效和滾動觸發效果的完整前端代碼。

同時,K2.5還引入了Agent Swarm機制,最多可以同時調度100個子Agent并行執行任務,完成多達1500次工具調用,任務執行速度提升4.5倍。

對于Cursor這種需要處理大型代碼庫、長鏈任務的產品來說,K2.5幾乎是量身定做的底座。

數據和實力之外,這場Cursor風波還意外地給K2.5送上了一波全球級的信用背書。

事實上,除了這次的抓包外,馬斯克一周內已經兩次點名Kimi。

3月16日,Kimi團隊在arXiv發布了一篇名為「Attention Residuals」的架構論文,馬斯克轉發并評價「Impressive work」。

與此同時,全球最大的CDN服務商Cloudflare也在同一周宣布,將Kimi K2.5作為Workers AI平臺上線的首個開源模型。

在官博中,Cloudflare透露了一個驚人的數字:他們內部有一個基于K2.5的安全審計Agent,每天處理超過70億智元(token)。

如果是用中等水平的閉源模型,僅這一個場景、一個代碼庫,年成本就要240萬美元。切換到K2.5之后,成本直降77%。

一個中國開源模型,同時被估值500億美元的硅谷編程工具選為基座、被全球CDN巨頭用于生產環境。

這種認可的含金量,不是隨便一次基準跑分能替代的。

有一說一

Composer 2確實能打

拋開基座爭議,Composer 2的性能本身還是值得一看得。

首先,它在跑分上實現了Cursor有史以來最大的單代際跳躍。

CursorBench上,Composer 2得分61.3,對比上一代Composer 1.5的44.2,提升近40%!

在測試AI在命令行環境中定位bug、編寫修復、驗證結果等全鏈路能力的Terminal-Bench 2.0上,Composer 2同樣拿到了61.7的高分,一舉超過Claude Opus 4.6的58.0和Opus 4.5的52.1。

雖然能力不是最強的,但成本確實是Composer 2最鋒利的武器。

標準版定價每百萬輸入智元(token)僅0.5美元,輸出2.5美元,比上一代Composer 1.5的3.5/17.5美元便宜了86%。

Composer 2 Fast不僅速度堪稱地表最快,而且定價也只提到了1.5/7.5美元,同樣比1.5版便宜57%。

相比之下,一個Claude Code訂閱月費200美元,背后的計算成本約為5000美元。

這個定價策略的底氣,來自Cursor在訓練層面做的真正有技術含量的事——compaction-in-the-loop強化學習。

Cursor的做法是把摘要過程直接嵌入RL訓練循環:當生成過程觸發智元(token)長度閾值時,模型自行暫停并壓縮上下文,從5000+智元(token)濃縮到約1000 智元(token)。

由于強化學習的獎勵函數覆蓋了整個鏈條(包括摘要步驟),模型學會了哪些細節必須保留、哪些可以丟棄。

結果顯示,上下文遺忘率比前代方法降低50%,模型可以處理需要數百步連續操作的項目級重構任務。也就是,智元(token)效率提升了5倍。

Composer 2還深度集成了Cursor的Agent工具鏈。包括語義代碼搜索、文件和文件夾檢索、文件讀寫、shell命令執行、瀏覽器控制和網頁訪問。

這套工具棧意味著Composer 2不只是一個回答問題的模型,而是一個可以在IDE里「動手干活」的Agent。

一句話總結:基座是別人的,但上層訓練確實下了功夫。

打開引擎蓋,里面全是中國造

Composer 2的技術含量不假。但這件事真正的看點,不在Cursor做了多少RL,而在于——當它需要一個最強底座的時候,選了誰。

而且Cursor不是個案,問題也不止出現在硅谷。

有研究顯示,日本十大主流AI模型中,六個的基座來自DeepSeek或Qwen系列,多數公司在宣傳中淡化甚至隱去了與底層模型的關聯。

換句話說,全球AI應用層的「地基」,正在被中國開源模型悄悄鋪滿。

從東京到舊金山,從獨立開發者到500億美元估值的公司,大家打開引擎蓋一看——里面跑的越來越多是中國造的發動機。

而網友Yuchen Jin的預測,則看得更遠:「開源模型實驗室未來會靠授權分成賺錢——這才是真正的飛輪。」

如果這個邏輯成立,Kimi免費放出K2.5,Cursor拿去做出20億美元年收入的產品,最終Kimi通過許可條款和品牌曝光把價值收回來。

開源不再是慈善,而是一種更高維度的商業策略。

這次事件最有趣的是,只需要一個開發者、一次API調試、一串沒改掉的模型ID,就把一家AI編程巨頭精心構建的「自研」敘事拆穿了。

不得不說,技術世界里最難隱藏的東西,永遠是代碼本身。