螞蟻集團旗下靈波科技近日宣布,其自主研發的具身大模型LingBot-VLA正式面向全球開發者開源。此次開源不僅包含模型核心權重,還首次開放了從數據處理、模型微調到自動化評估的全流程代碼庫,為具身智能領域的技術落地提供了完整工具鏈支持。

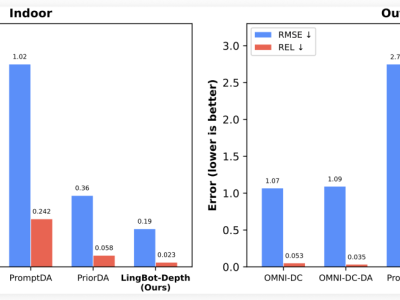

據靈波科技CEO朱興介紹,該模型通過模塊化設計將訓練周期壓縮60%以上,顯著降低了具身智能商業化落地的算力成本與時間門檻。開發者可基于開源代碼庫,快速將模型適配至工業巡檢、家庭服務、物流搬運等多樣化場景,無需從零構建技術棧。這一突破性進展有望推動具身智能技術從實驗室走向規模化應用。

作為螞蟻集團InclusionAI技術體系的重要實踐,LingBot-VLA是首個開源的具身智能基座模型。該體系整合了基礎模型架構、多模態感知、因果推理等核心技術模塊,已形成覆蓋機器人運動控制、環境交互、任務規劃的完整技術生態。朱興表示:"開源是驗證技術普適性的最佳路徑,我們希望通過開放核心代碼,加速構建可復用、可驗證的具身智能開發范式。"

在技術合作層面,LingBot-VLA的研發獲得了產業鏈上下游企業的協同支持。數據采集階段使用了星海圖、松靈的機器人硬件平臺,樂聚、庫帕思等機構提供了多模態訓練數據;模型預訓練階段則整合了國家地方共建人形機器人創新中心、博登智能等單位的高質量數據集。目前該模型已與星海圖移動機器人、松靈機械臂、樂聚人形機器人完成適配驗證,展現出跨本體遷移的強泛化能力。

行業分析指出,具身智能作為連接數字世界與物理世界的橋梁,其發展高度依賴基座模型的開放程度。螞蟻集團此次開源行動不僅降低了技術準入門檻,更通過構建開源生態加速了技術迭代速度。隨著LingBot-VLA在工業制造、智慧物流等領域的逐步滲透,具身智能有望成為下一代人工智能的重要基礎設施。