AIPress.com.cn報道

2月3日消息,據路透社報道,多名知情人士透露,OpenAI 對英偉達部分最新人工智能芯片在特定場景下的表現并不完全滿意,自去年起已開始評估用于 AI 推理(inference)的替代芯片方案。

報道指出,OpenAI 調整芯片策略,主要源于其對 AI 推理階段算力需求的重視不斷提升。與訓練大型模型不同,推理階段涉及模型在實際使用中對用戶請求作出響應,其性能直接影響應用的響應速度和用戶體驗。盡管英偉達在大模型訓練芯片領域仍占據主導地位,但推理正成為新的競爭焦點。

多名消息人士稱,OpenAI 已與 AMD 以及初創公司 Cerebras、Groq 等就推理芯片展開接觸,評估其在速度和架構上的潛在優勢。知情人士補充稱,OpenAI 希望未來約 10% 的推理算力需求能夠由不同于英偉達 GPU 的硬件承擔。

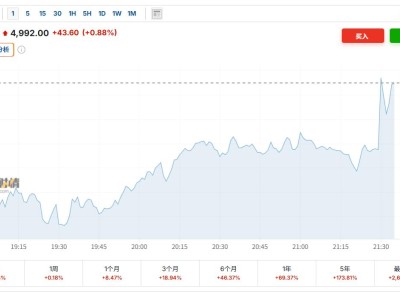

2025年9月,英偉達曾表示計劃向 OpenAI 投資最高達 1000 億美元,并為 OpenAI 提供采購先進芯片的資金支持。該交易原本預計在數周內完成,但目前談判已持續數月仍未落定。消息人士稱,OpenAI 產品路線圖的變化以及對計算資源類型的新需求,成為談判進展放緩的原因之一。

針對外界關于雙方關系緊張的報道,英偉達首席執行官黃仁勛近日公開否認存在分歧,稱相關說法“毫無根據”。英偉達在聲明中表示,客戶之所以在推理領域繼續選擇英偉達,是因為其在大規模部署下具備最佳性能和總體擁有成本。

OpenAI 方面則回應稱,公司目前仍高度依賴英偉達芯片來支撐其絕大多數推理算力,并認為英偉達在推理場景下提供了“最佳的性價比”。在路透報道發布后,OpenAI 首席執行官 Sam Altman 也在社交平臺 X 上表示,英偉達“制造了世界上最好的 AI 芯片”,OpenAI 希望在未來很長一段時間內仍是英偉達的重要客戶。

不過,消息人士透露,OpenAI 內部對英偉達 GPU 在部分應用場景中的響應速度存在擔憂,尤其是在軟件開發和 AI 與其他軟件系統交互等高頻、低延遲需求的任務中。該問題在 OpenAI 的編程產品 Codex 中尤為明顯,一些員工認為其性能瓶頸部分源于當前 GPU 架構。

從技術層面看,OpenAI 對替代方案的興趣,集中在采用大量片上 SRAM(靜態隨機存儲器)的芯片架構。相比依賴外置顯存的 GPU,SRAM 高度集成的芯片在推理過程中可減少數據往返時間,從而提升響應速度。由于推理階段對內存訪問的依賴程度高于訓練階段,這一差異尤為關鍵。

Altman 在1月30日與媒體的電話會議中也表示,使用 OpenAI 編程模型的客戶“會對速度給予極高的優先級”。他指出,OpenAI 已通過與 Cerebras 的合作來滿足部分高性能推理需求,而對于普通 ChatGPT 用戶而言,速度要求相對寬松。

相比之下,Anthropic 的 Claude 以及 Google 的 Gemini,在部署中更多依賴各自的自研芯片,例如 Google 的 TPU(張量處理單元)。這些芯片針對推理和推理型計算進行了專門優化,在部分場景中相較通用 GPU 具備性能優勢。

隨著 OpenAI 明確表達對推理性能的更高要求,英偉達也開始主動接觸 Cerebras、Groq 等 SRAM 架構芯片公司,探索收購或合作的可能性。最終,英偉達于去年12月與 Groq 達成一項價值約200億美元的非獨占技術授權協議,并表示 Groq 的知識產權與其產品路線高度互補。

該交易雖不排他,但 Groq 此后戰略重心已轉向云軟件服務,同時英偉達也吸納了 Groq 的部分芯片設計人員。(AI普瑞斯編譯)