可靈AI正式推出3.0系列模型,標(biāo)志著人工智能在影視與創(chuàng)意內(nèi)容生產(chǎn)領(lǐng)域?qū)崿F(xiàn)重大突破。該系列涵蓋視頻生成、圖片生成及編輯全流程,通過多模態(tài)交互技術(shù)將創(chuàng)作環(huán)節(jié)整合為閉環(huán)系統(tǒng),為專業(yè)創(chuàng)作者提供影視級(jí)生產(chǎn)工具。目前黑金會(huì)員已可體驗(yàn),預(yù)計(jì)近期面向全體用戶開放。

全新模型體系基于All-in-One架構(gòu)設(shè)計(jì),突破傳統(tǒng)工具鏈的碎片化模式。創(chuàng)作者可同時(shí)輸入文字、圖像、音頻及視頻素材,直接獲得專業(yè)級(jí)影像輸出。這種一體化設(shè)計(jì)使鏡頭調(diào)度、主體錨定與敘事推進(jìn)等核心環(huán)節(jié)首次在單一模型內(nèi)完成,顯著提升創(chuàng)作效率與成品質(zhì)量。

針對行業(yè)長期存在的主體穩(wěn)定性難題,3.0系列引入多項(xiàng)創(chuàng)新技術(shù)。通過視頻主體上傳、音色綁定及全球首創(chuàng)的"圖生視頻+主體參考"機(jī)制,確保人物形象、動(dòng)作及聲音在復(fù)雜鏡頭切換中保持高度一致。即便在多語言場景下,視覺風(fēng)格與角色特征仍能實(shí)現(xiàn)跨鏡頭統(tǒng)一,文字清晰度與品牌標(biāo)識(shí)可識(shí)別性達(dá)到新標(biāo)準(zhǔn)。

敘事能力方面,模型支持最長15秒的連續(xù)生成,配備智能分鏡系統(tǒng)與自定義鏡頭控制功能。創(chuàng)作者可直接組織鏡頭節(jié)奏與敘事結(jié)構(gòu),避免傳統(tǒng)剪輯的碎片化拼接。視頻3.0版本更實(shí)現(xiàn)多語種原生音畫同步,人物口型匹配精度提升至影視級(jí)標(biāo)準(zhǔn),情緒表達(dá)張力顯著增強(qiáng)。

Omni版本在角色一致性領(lǐng)域取得突破性進(jìn)展。通過特征解耦技術(shù),模型可精準(zhǔn)提取并綁定特定主體的視覺特征與音色,實(shí)現(xiàn)跨場景自由復(fù)用。該版本攻克文字變形難題,結(jié)合靈活的分鏡控制,使AI生成內(nèi)容達(dá)到專業(yè)影視"直接交付"標(biāo)準(zhǔn),為導(dǎo)演提供高度可控的數(shù)字創(chuàng)作伙伴。

圖片模型系列聚焦靜態(tài)敘事強(qiáng)化,支持2K/4K超高清輸出與系列組圖生成。新版本可深度解構(gòu)提示詞中的視聽元素,精準(zhǔn)把控構(gòu)圖邏輯與視角關(guān)系,滿足影視分鏡、場景設(shè)定等專業(yè)需求。組圖間風(fēng)格、光影與細(xì)節(jié)的高度統(tǒng)一性,確保視覺物料符合行業(yè)嚴(yán)苛標(biāo)準(zhǔn)。

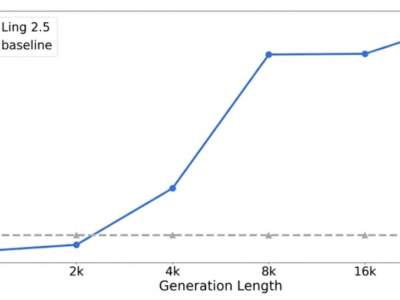

技術(shù)演進(jìn)路徑顯示,可靈AI已完成三次關(guān)鍵躍遷:從2024年6月推出全球首個(gè)用戶級(jí)DiT視頻生成模型開啟"可用時(shí)代",到2.0階段通過能力提升實(shí)現(xiàn)"好用"演化,最終在3.0版本達(dá)成"專業(yè)調(diào)度"的系統(tǒng)性跨越。最新模型在生成質(zhì)量與可控性兩大維度取得突破,使AI從創(chuàng)作工具進(jìn)化為理解意圖的協(xié)作者。

實(shí)際應(yīng)用場景中,影視廣告創(chuàng)作者可利用智能分鏡快速驗(yàn)證創(chuàng)意,游戲與虛擬制作領(lǐng)域則通過角色一致性技術(shù)加速數(shù)字資產(chǎn)構(gòu)建。公開數(shù)據(jù)顯示,該平臺(tái)已聚集超6000萬創(chuàng)作者,累計(jì)生成6億個(gè)視頻,服務(wù)3萬家企業(yè)用戶,年化收入運(yùn)行率達(dá)2.4億美元。此次升級(jí)標(biāo)志著AI正式進(jìn)入影視生產(chǎn)核心環(huán)節(jié),為內(nèi)容創(chuàng)作帶來范式變革。