在科技發展的浪潮中,具身智能正經歷著深刻變革,而春晚舞臺成為了這一變革的生動展示窗口。曾經,具身智能人形機器人在大眾視野中的亮相還帶著諸多局限。以2025年宇樹H1在春晚的表現為例,當時它處于技術驗證階段,僅能完成基礎舞蹈動作,運動控制能力未得到集中展現,整機動態軌跡不夠流暢,在自主移動和地面適應性方面也存在明顯不足,這反映出人形機器人從實驗室技術邁向實用化產品過程中面臨的階段性瓶頸。

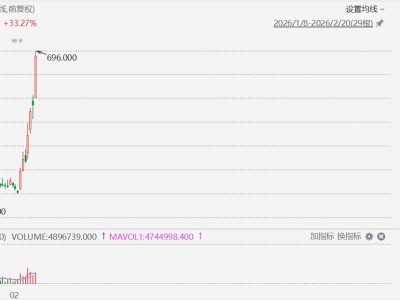

然而,僅僅一年后的2026年馬年春晚,具身智能人形機器人實現了驚人跨越。宇樹攜G1與H2兩款人形機器人登場,以全球首次全自主人形機器人集群武術表演驚艷眾人。16臺機器人組成的集群快速跑位,完成醉拳、雙截棍、舞劍等高難度武術動作,還能與武術表演者精準配合,實現道具的快速更換與穩定抓持,無論是運動控制、操作軌跡絲滑度還是群體協同,都展現出質的飛躍。

舞臺上的精彩表現只是具身智能發展的一個縮影,在舞臺之外,具身智能的作業智能也取得了重大突破。長序列任務執行與柔性物體操控這兩大技術難點實現了規模化落地,其中完成“疊衣服”這一高難度任務尤為引人注目。該任務涉及柔性形變感知、時序動作規劃、精細力控反饋等全鏈路挑戰,是具身智能從結構化場景走向非結構化場景的關鍵阻礙。

當人們驚嘆于機器人高難度動作時,更應深入探究其背后的產業范式革命。機器人的能力躍升并非單純的技術參數堆砌。無論是通過特定方式緩解“數據饑渴”,還是借助閉環反饋填平“虛實鴻溝”,這些技術迭代都只是具身智能發展的“表層切面”。真正推動行業質變的是底層思考邏輯的根本性重構,機器人正從“照貓畫虎”的模仿學習路徑,轉向“理解世界、預判未來”的模式,仿佛人形機器人乃至整個具身智能領域都在集體“開智”。

這場“開智”革命并非單一技術路線的成果,當下支撐這一范式轉變的技術路線已分化為多個核心派系,不同技術邏輯相互碰撞與融合,共同塑造著具身智能的產業走向。其中,智能基座——模型成為“開智”的核心錨點。模型的架構設計直接決定了機器人理解物理世界、適配復雜任務的能力邊界,而圍繞“如何讓機器人真正開智”的產業競賽,正圍繞VLA架構的演進與爭議進入關鍵階段。

此前,行業形成明確共識,認為人形機器人的能力突破離不開端到端VLA(Vision-Language-Action,視覺-語言-動作)架構的核心驅動。這種架構融合視覺感知、語言理解與動作生成三大模態,打破了傳統“感知-規劃-控制”分層架構的信息損耗難題,實現端到端閉環。谷歌DeepMind、智元機器人等中外企業的技術落地,驗證了其在結構化場景中的適配準確率,也使其逐步成為人形機器人從實驗室走向商業化的核心技術底座。

但隨著需求側向非結構化場景、長序列復雜任務延伸,VLA架構的局限性逐漸顯現。例如,王興興評價行業常見的VLA模型為“傻瓜式架構”,對其持懷疑態度,不少業內人士也開始探討VLA模型是具身智能的終局還是階段性過渡方案。這些爭議的核心聚焦于“VLA中的L(語言)是否必要”,本質是對具身智能底層邏輯的重新審視。此前業內過度關注語言的必要性,是借鑒了LLM的成功經驗,但具身智能需要與物理世界真實交互,這種交互的骨架是否仍為語言尚不明確。李飛飛曾提到“語言從根本上來說是一種純粹生成的信號,世界上本沒有語言”,星海圖CTO趙行也表示具身智能需要平行于大語言模型的“Large Action Model”,以“動作”為核心,因為人類智能的進化是“先有動作、再有視覺、最后有語言”,機器人適應物理世界也應遵循類似邏輯。

這場架構之爭指向一個根本產業命題:機器人應以何種方式理解世界,是通過人類語言這一“間接符號”,還是通過動作與環境的“直接交互”構建認知,或者以世界模型為核心,讓機器人在自己世界里“腦補”動作流,進而更順暢地在真實世界執行。業內逐漸形成共識,具身智能的終局架構必然是對物理世界認知邏輯的精準抽象,可能保留VLA架構的跨模態融合優勢,也可能剝離冗余的語言中介,但核心必須適配機器人作為物理實體的交互本質,實現“感知-決策-執行”與物理世界規律的深度對齊。

在尋找下一個模型架構時,模型的打開方式至關重要,即如何確定機器人所需的模型架構。答案藏在機器人落地的底層邏輯中,真正轉化為生產力的人形機器人都是聽懂了場景訴求、從真實交互中發展而來,模型架構的進化同樣需要回歸機器人與世界對話的原生方式。機器人在真實工作場景中,無論是疊衣服還是擰螺絲,都需要具備“長時序記憶與實時反饋能力”“動態場景的隨機應變能力”,這兩大能力的核心是“預判未來狀態”,而非簡單“記住過往數據”。

以人類執行疊衣服、裝配零件等任務為例,不會逐幀依賴視覺反饋,而是基于物理常識預判下一步動作結果。機器人要實現“絲滑操作”,關鍵在于將“記憶”升級為“預測”,通過模型推演未來多幀的場景變化與動作后果。螞蟻靈波開源的具身世界模型LingBot-VA將“先預測、再動作”的架構邏輯推向極致,創新性地提出自回歸視頻-動作世界建模框架,將“預測世界狀態”與“生成動作序列”深度綁定,實現“邊預測,邊動作”,不再是機械執行預設指令,而是每一步操作時大腦都在實時推演接下來的畫面。該模型不僅思維模式與人類相似,工作特性也高度重合,能記住操作過程,具備泛化能力,學會洗盤子后就能洗碗,還能輕松完成清洗細小透明試管等高精度任務。

英偉達的DreamGen也采用類似思路,先生成視頻,再反推動作,其基礎模型架構分為上下兩部分,上半部分視頻模型負責預測未來,下半部分負責看著預測視頻反推并輸出動作。不過,DreamGen推出時雖被寄予厚望,但尚未跑通閉環,原因是現實世界充滿變量,機器人執行中出現微小物理偏差時,由于視頻提前生成,模型無法實時修正畫面,導致“腦子想的和手做的”脫節。但這并不意味著DreamGen是失敗嘗試,相反,它印證了世界模型是機器人在真實物理世界作業的核心支撐,只是當時尚未抵達產業臨界點,而LingBot-VA的問世補齊了最后一塊短板,成為具身世界模型完整閉環跑通的標志性拐點。

“用機器人的視角打開世界”,本質是讓模型架構回歸物理世界的本質規律。機器人不需要像人類一樣通過語言理解“重力”“摩擦力”,但需要通過預測能力感知這些物理規則;不需要記住每一個場景的操作參數,但需要能推演不同場景下的動作后果。這種以“預測”為核心的架構邏輯,契合了機器人與物理世界交互的原生需求,擺脫對人類認知中介(語言)的依賴,直接通過“預測-行動”的閉環建立與世界的直接連接,是具身智能走向“適配世界”的重要跨越。

具身世界模型有望成為具身智能的關鍵能力與重要基座,其融合了“世界模型”與“物理動作反饋閉環”,并非簡單技術疊加,而是深度融合。世界模型為機器人搭建可預判、可推演的虛擬世界,提前模擬動作后果與環境變化;物理動作反饋將現實交互中的數據實時回灌模型,持續校準虛擬與現實的偏差,形成自進化閉環。它從根源上重構了機器人理解物理世界的底層邏輯,讓機器人擺脫對人工指令、標注數據與固定軌跡的依賴,成為破解非結構化場景適配難、長時序任務穩定性差、柔性操作精度不足等行業落地瓶頸的核心能力支柱。

在產業視角下,我們既不應否認VLA的貢獻,也不能盲目推崇VA的未來,而應站在機器人的視角看待世界,傾聽機器人對模型架構的需求。這場模型架構變革是產業更清醒的信號,也是具身智能走向規模化商用的關鍵一步。模型架構的底層突破直接決定了機器人的泛化能力、作業精度與落地成本,將推動行業從舞臺化的技術展示走向工業、家政、特種作業等真實場景的生產力釋放,為整機研發、場景方案、商業化落地劃定清晰的技術主線。