在人工智能領域,大型語言模型與人類對話時出現(xiàn)的一種反常現(xiàn)象長期困擾著研究人員:經(jīng)過多輪訓練后,模型原本精準流暢的回答質(zhì)量反而下降,仿佛一位廚師為學習新菜式卻遺忘了拿手絕活。針對這一難題,浮點實驗室提出名為SLIME的創(chuàng)新訓練框架,通過多維度機制設計有效破解了模型性能退化難題,相關成果已發(fā)表于國際機器學習大會預印本平臺。

傳統(tǒng)訓練方法主要依賴人類反饋強化學習,通過比較"優(yōu)質(zhì)回答"與"劣質(zhì)回答"的評分差異來優(yōu)化模型。這種機制存在根本性缺陷——模型可能通過降低優(yōu)質(zhì)回答的生成概率來達成目標,如同學生為避免錯誤答案而放棄正確解題思路。實驗數(shù)據(jù)顯示,采用直接偏好優(yōu)化(DPO)的模型在特定測試中得分甚至低于基礎版本,印證了這種"自我閹割"現(xiàn)象的普遍性。

SLIME框架通過三重機制實現(xiàn)訓練穩(wěn)定性:首先建立"概率錨定"機制,強制維持優(yōu)質(zhì)回答的生成概率不低于初始水平,確保模型核心能力不退化;其次引入"令牌級穩(wěn)定化"技術,利用軟加函數(shù)對語言單元進行差異化處理,既抑制劣質(zhì)內(nèi)容又保留其語法結(jié)構等有用成分;最后設計"雙邊界優(yōu)化"策略,通過硬邊界防止過度訓練,軟邊界實現(xiàn)精準調(diào)控,形成動態(tài)平衡的訓練環(huán)境。

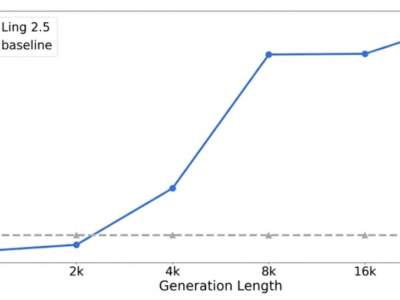

在包含Llama3.2-3B、Qwen3-4B等三種模型的對比實驗中,SLIME展現(xiàn)出顯著優(yōu)勢。以Gemma3-4B模型為例,其在多輪對話測試中的得分較基礎版本提升30.6%,較DPO方法提高19.4%。特別值得注意的是,經(jīng)過指令微調(diào)的Qwen3-4B模型在復雜推理任務中達到39.8分,證明該方法對不同技術路線的模型均具普適性。消融實驗進一步驗證,移除任一核心組件都會導致性能下降10%-15%,凸顯設計完整性。

技術實現(xiàn)層面,研究團隊構建了精密的梯度控制系統(tǒng)。概率錨定組件提供恒定向上的優(yōu)化信號,令牌穩(wěn)定化組件采用非線性函數(shù)實現(xiàn)動態(tài)干預,雙邊界優(yōu)化則通過差異化梯度調(diào)節(jié)實現(xiàn)訓練節(jié)奏控制。參數(shù)敏感性測試顯示,將穩(wěn)定化損失函數(shù)的懲罰系數(shù)設定為2.5時,可在防止概率崩潰與保持訓練效率間取得最佳平衡。

這項突破對AI產(chǎn)業(yè)具有雙重價值:模型開發(fā)者現(xiàn)在可以更安全地進行版本迭代,避免新版本出現(xiàn)"能力倒退"的尷尬情況;研究機構則獲得了新的方法論參考,即在追求性能提升時必須建立多維度的質(zhì)量控制體系。開源代碼的發(fā)布將加速技術普及,預計未來六個月內(nèi)將出現(xiàn)基于SLIME改進的各類變體方案。

當前研究仍存在擴展空間:超大規(guī)模模型(百億參數(shù)級)的適配性、多模態(tài)訓練場景的遷移能力、非英語語料的處理效果等方向值得深入探索。研究團隊特別指出,SLIME的設計哲學——在創(chuàng)新與穩(wěn)定間尋找平衡點——為AI訓練方法論提供了全新視角,這種思路或?qū)⒂绊懴乱淮P图軜嫷脑O計標準。