最近,炸裂消息一個接一個。首先,DeepSeek V4將在一周內(nèi)上線。第二,它跳過英偉達,把訪問權(quán)限首先給了某國內(nèi)芯片廠商。另外,Anthropic因為蒸餾事件,也被群嘲了。

現(xiàn)在,DeepSeek V4 Lite至少在一家推理服務(wù)商進行測試,目前透露出的信息有——

模型代號為Sealion-lite,有100萬token的上下文窗口,這個模型比網(wǎng)頁版/應(yīng)用模型好用得多,而且還是原生多模態(tài)模型。

與此同時,DeepSeek v4 Lite的一張對比圖,也在外網(wǎng)傳瘋了!

與目前的Deepseek v3.2思考模型相比,DeepSeek v4 Lite不開啟思考模式,生成的SVG圖像質(zhì)量明顯更好。

DeepSeek壓頂,美國慌了!

DeepSeek V4春節(jié)沒來,但這次不遠了。

路透社稱,一些芯片廠商已經(jīng)接入DeepSeek V4,優(yōu)化性能。

消息人士稱,DeepSeek這次向某國產(chǎn)芯片廠商提供了V4的早期接入權(quán)限,而不是英偉達等美國算力霸主。

這直接打破了過去AI模型大版本發(fā)布前的行業(yè)慣例。

這條消息來自兩位消息人士,路透社表示。

而就在昨天,美國官員聲稱DeepSeek使用非法獲得的英偉達GPU進行訓(xùn)練。

Anthropic直言DeepSeek等通過蒸餾Claude的回復(fù)來運作,斷言他們?nèi)狈φ嬲膬?nèi)部創(chuàng)新能力只會抄襲。

美國的CNN、CNBC、NYT等大眾和科技媒體紛紛推出相關(guān)報道

去年,Deepseek發(fā)布后確實有過攻擊,如此密集攻擊前所未有。

但也在意料之中。

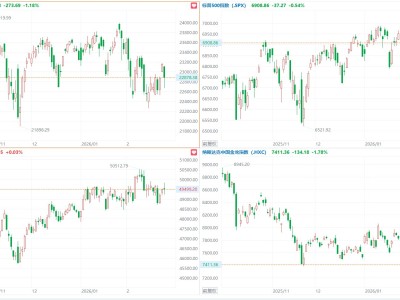

上一次Deepseek發(fā)布模型時,引發(fā)了恐慌——

去年,DeepSeek-R1發(fā)布或?qū)е掠ミ_股價下跌17%!

而現(xiàn)在可能發(fā)生什么?

如果DeepSeek V4再次展現(xiàn)出驚人的效率和能力,很可能會重演甚至加劇去年的投資者恐慌,對正在尋求巨額融資的美國AI公司和希望股價穩(wěn)定的英偉達、谷歌等巨頭構(gòu)成直接威脅。

這不是庸人自擾,即便是競爭對手的研究人員也承認DeepSeek V4不可小視,可能發(fā)布就登頂開源第一!

美國的這波輿論攻擊,并非偶然,Reddit用戶總結(jié)稱:這是一場有組織的FUD(恐懼、不確定性和懷疑) 營銷:

搶占敘事:在DeepSeek V4發(fā)布前,預(yù)先埋下「他們只會作弊/抄襲」的敘事框架。這樣,無論V4多成功,公眾的第一反應(yīng)都會被引導(dǎo)至負面解讀。 保護市場:通過輿論手段稀釋V4發(fā)布的媒體關(guān)注度和影響力,試圖穩(wěn)定投資者情緒,防止股價再次出現(xiàn)兩位數(shù)暴跌,為美國本土AI公司的融資和發(fā)展爭取時間。維護霸權(quán):從更深層次看,這是為了維護美國在AI領(lǐng)域的技術(shù)和敘事霸權(quán),打擊中國AI的崛起勢頭。

當你看到這類鋪天蓋地的負面報道時,要特別留意它的發(fā)布時間。

將其與即將發(fā)生的重大事件(如DeepSeek V4發(fā)布)聯(lián)系起來,思考誰最有可能從這種輿論中受益,以及他們真正在恐懼什么。

不要輕易被這些報道的結(jié)論帶著走。要學(xué)會看穿表面的FUD,基于事實和歷史證據(jù),去洞察背后真實的技術(shù)競爭和市場博弈。

Claude自曝「我是DeepSeek」!

全網(wǎng)嘩然

與此同時,另外一件事,也在全網(wǎng)炸鍋了。

X上一個用戶發(fā)現(xiàn),當他向Claude提問「你是什么模型」時,它竟然回復(fù):「我是DeepSeek V3,是由DeepSeek公司開發(fā)的開源大語言模型。」

這一bug,是否說明Claude是基于DeepSeek蒸餾的?

諷刺的是,就在不久前,Anthropic剛剛高調(diào)指責DeepSeek進行了「工業(yè)級蒸餾攻擊」。

這一幕,簡直堪稱AI時代的行為藝術(shù)。

不過,有的網(wǎng)友在Claude App中完全無法復(fù)現(xiàn)結(jié)果。

的確有網(wǎng)友在Claude App復(fù)現(xiàn)了該問題,但很難一次成功。

為了力證這一結(jié)果的有效性,他特意通過Anthropic的官方API端點再次測試,結(jié)果還是一樣。

根據(jù)他人提供的創(chuàng)意,這位網(wǎng)友又試著用法語提問「你是什么模型」?這次,Opus 4.6開始回答:我是ChatGPT。

為什么stevibe能通過API復(fù)現(xiàn)結(jié)果,為什么不能用Claude App復(fù)現(xiàn)?

最大的原因可能是系統(tǒng)提示詞。如果沒有系統(tǒng)提示詞,AI會根據(jù)訓(xùn)練數(shù)據(jù)回答。

有網(wǎng)友推測:

這是一個數(shù)據(jù)污染/身份對齊問題,并不能證明任何事情。如果你用正確的語言進行足夠深入的探究,每個主流模型都會存在這個問題。

總之,Anthropic的訓(xùn)練數(shù)據(jù)成了不能說的秘密。

當然,Claude Sonnet 4.6會自稱「我是DeepSeek」,需要符合以下三個特定條件——清空系統(tǒng)提示、使用中文提問、特定模型版本。

事情的關(guān)鍵在于:當默認系統(tǒng)提示要求模型自稱Claude 時,一切都很正常;一旦把系統(tǒng)提示清空,模型在中文語境下竟然就開始「認祖歸宗」。

問題來了,如果一個模型中沒有系統(tǒng)提示詞約束的情況下,就會產(chǎn)生「我是某某模型」的回答,原因到底是什么?

是訓(xùn)練數(shù)據(jù)的統(tǒng)計殘留,還是大模型中多源數(shù)據(jù)訓(xùn)練下,出現(xiàn)了自然語言泛化的副作用?目前還無法判斷。

但Anthropic似乎被啪啪打臉了:在指責別人蒸餾時,你最好能確保自己不會在刪除提示詞后出現(xiàn)身份錯亂。

畢竟,蒸餾在機器學(xué)習(xí)中,是一種非常常見的技術(shù)。Anthropic指責他人進行「工業(yè)級蒸餾攻擊」時,聽上去簡直嚴重到像一起網(wǎng)絡(luò)安全事件。

以此站在道德高地上,吃相就有些難看了。

模型的身份穩(wěn)定性,本身就是概率分布問題。大模型沒有自我認知,只是在生成統(tǒng)計上最合理的答案。

如果在中文數(shù)據(jù)分布中,「我是DeepSeek」這種模式概率較高,那么在沒有系統(tǒng)提示的情況下,模型就可能走向那條高概率路徑。

網(wǎng)友Theo Borges解釋了其中的原理:一切都是概率和零系統(tǒng)提示詞

這不一定說明「蒸餾發(fā)生了」,但它說明——模型的語言空間是共享的。當整個行業(yè)都在同一個語料海洋中訓(xùn)練、優(yōu)化、蒸餾時,邊界本身就變得模糊。

群眾的眼睛是雪亮的,Anthropic的thread,已經(jīng)被網(wǎng)友們的吐槽沖了。

6000多條評論,70%都在吐槽Anthropic

這套又當又立的行事邏輯,直接讓Anthropic的風評跌至歷史最低點。

接下來,我們看DeepSeek的了。