谷歌DeepMind近日宣布對視頻生成模型Veo進行重大升級,推出3.1版本并新增多項核心功能。此次更新聚焦于提升AI生成視頻的質量與實用性,重點優化了基于參考圖片生成視頻的能力,同時首次支持原生豎屏視頻輸出,為短視頻創作者提供更專業的工具。

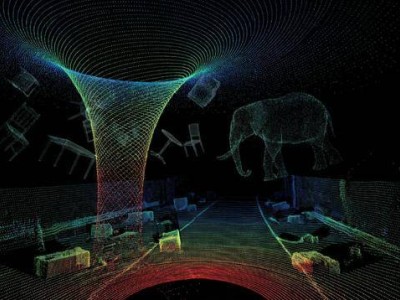

在動態畫面生成方面,Veo 3.1展現出顯著進步。即使使用簡短的文字提示,模型也能生成更自然的角色動作與表情變化,并保持敘事邏輯的連貫性。通過改進的算法架構,系統可精準捕捉參考圖中的關鍵元素,在多鏡頭切換中維持人物外觀、背景細節與物體紋理的高度一致,有效解決傳統AI視頻生成中常見的"跳幀"或"變形"問題。

針對移動端創作需求,新版模型特別增加了9:16豎屏視頻生成功能。這一改進使創作者無需后期裁剪即可直接產出適配手機屏幕的內容,避免因畫面壓縮導致的畫質損失。配合新增的1080p至4K超分辨率輸出選項,該技術可同時滿足社交媒體日常分享與專業影視制作的不同標準。

技術實現層面,DeepMind團隊引入新一代神經網絡架構,通過優化注意力機制與時空建模能力,顯著提升視頻生成的穩定性。在角色一致性測試中,系統能在包含12個場景切換的復雜敘事中,保持主要人物外觀特征誤差率低于3%。背景元素復用功能則通過建立視覺元素庫,實現跨片段的無縫銜接。

目前相關功能已集成至谷歌生態多個產品平臺,包括Gemini智能助手、YouTube短視頻創作工具、Google Vids專業視頻編輯器等。開發者可通過Vertex AI平臺調用新版API,企業用戶則能在Gemini企業版中獲取定制化解決方案。所有生成內容均會自動嵌入SynthID隱形數字水印,配合升級后的內容識別系統,形成完整的AI創作溯源鏈條。

此次升級標志著AI視頻生成技術向專業化、場景化方向邁出重要一步。通過解決畫質損耗、角色一致性等核心痛點,Veo 3.1為廣告營銷、影視預演、教育科普等領域提供了更高效的創作工具。隨著原生豎屏支持與多分辨率輸出的實現,移動端視頻生產流程有望得到進一步簡化。